酒店行業作為服務經濟的重要組成部分,近年來在消費升級與市場競爭加劇的背景下,面臨新的機遇與挑戰。央財智庫從行業研究框架出發,聚焦強管理輸出與“產品為王”兩大核心維度,深入分析酒店管理的戰略路徑與運營實踐。

一、行業概述與發展趨勢

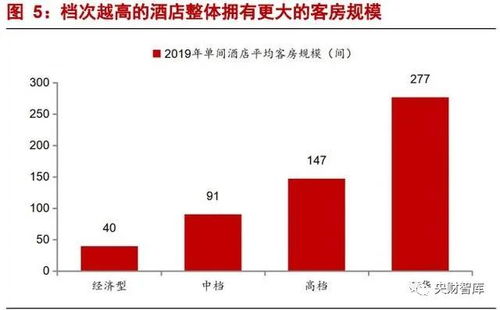

酒店行業已從傳統的“重資產”模式向輕資產、品牌化、連鎖化轉型。隨著旅游消費需求多樣化,中高端酒店市場快速增長,而經濟型酒店則面臨同質化競爭壓力。行業整體呈現以下趨勢:品牌集中度提升、數字化技術應用深化、綠色可持續發展理念普及。

二、強管理輸出的核心邏輯

強管理輸出是酒店行業實現規模化擴張與品牌價值提升的關鍵。其核心在于通過標準化的運營體系、人才培訓機制與品牌文化滲透,實現對合作方或加盟店的有效管控。具體表現為:

1. 標準化運營:建立統一的客房服務、餐飲管理、衛生安全等標準,確保服務質量一致性。

2. 人才梯隊建設:通過內部培訓學院與外部合作,培養具備專業素養的管理團隊與服務人員。

3. 品牌賦能:以成熟的品牌形象與營銷網絡,幫助合作方快速獲取市場認可。

強管理輸出不僅降低了單店運營風險,還通過規模效應提升了行業整體效率。

三、產品為王的戰略導向

在酒店行業,“產品為王”強調以用戶體驗為中心,通過差異化產品設計贏得市場競爭。這包括:

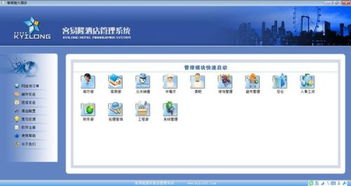

1. 硬件設施升級:引入智能客房系統、環保材料、個性化空間設計,提升住客舒適度。

2. 服務創新:結合本地文化特色,開發主題客房、定制化旅行服務等增值產品。

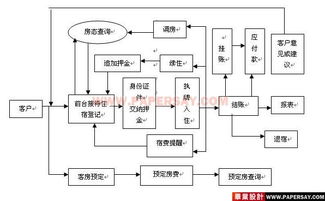

3. 數字化轉型:利用大數據分析用戶偏好,優化預訂流程與會員服務體系。

產品力成為酒店能否在紅海市場中脫穎而出的決定性因素,尤其在中高端細分領域更為明顯。

四、管理輸出與產品創新的協同效應

強管理輸出與產品為王并非孤立策略,而是相互促進的有機整體。標準化管理為產品創新提供穩定的質量基礎,而獨特的產品設計則增強了品牌溢價能力,進一步推動管理輸出模式的可持續發展。例如,國際酒店集團通過“管理合同”模式,將品牌標準與本地化產品結合,實現了全球擴張與本土適應的平衡。

五、挑戰與建議

盡管強管理輸出與產品創新帶來顯著優勢,酒店行業仍面臨人才短缺、成本上升與消費者需求多變等挑戰。對此,建議:

- 加強供應鏈管理,控制運營成本;

- 深化與科技公司合作,提升數字化水平;

- 注重ESG(環境、社會與治理)實踐,構建長期競爭力。

結語

在酒店行業競爭日趨激烈的背景下,強管理輸出確保了運營效率與品牌一致性,而“產品為王”則驅動了用戶體驗與市場差異化。成功的企業需將二者深度融合,以管理賦能產品,以產品反哺管理,從而在變革中抓住增長機遇。